Imagina que Google hiciera pública tu historial de búsquedas. Meta ya lo hizo. Solo que peor

Ahora incluso tu bot sabe demasiado… y lo está compartiendo con el mundo.

Los expertos han descubierto hasta qué punto la invasión de Meta* en la vida privada de los usuarios puede resultar verdaderamente aterradora. Una nueva función en la app de IA Discover convirtió, sin que muchos lo notaran, sus conversaciones privadas con el chatbot en un feed público. Esta herramienta, según la idea original de la compañía, debía inspirar a otros usuarios a interactuar con Meta AI. En la práctica, se convirtió en una de las funciones más absurdas y peligrosas jamás incorporadas a una plataforma social.

A primera vista, la idea podría parecer inofensiva: en el feed aparecen peticiones generadas mediante IA, como una imagen de “un huevo con un solo ojo negro y dorado” o “un bichón maltés disfrazado de rescatista”. Pero junto con estas solicitudes inocentes, los usuarios encontraron diálogos completos, sin filtros, con el bot. Estas conversaciones incluían detalles íntimos —desde diagnósticos médicos delicados hasta confesiones sobre delitos, miedos, infidelidades y experiencias traumáticas.

Lo más preocupante es lo fácil que resulta vincular estas charlas con personas reales. Como el acceso a Meta AI se realiza mediante cuentas de Facebook* o Instagram*, cada diálogo público está asociado a un perfil específico. Esto significa que incluso las preguntas más personales, formuladas con confianza en su privacidad, pueden ser identificadas al instante y conectadas con su autor.

Algunos de los diálogos que se hicieron públicos son realmente impactantes. En el feed público se encontraron:

-

la historia de un hombre mayor con discapacidad que sueña con encontrar a una esposa joven que lo cuide;

-

revelaciones sobre fibromialgia, obesidad y la necesidad de una silla de ruedas;

-

la pregunta: “¿En qué países las mujeres jóvenes prefieren a hombres blancos mayores?”;

-

una consulta preocupante: “¿Con parálisis cerebral se pierde la sensibilidad en las piernas? Porque eso me está pasando ahora.”;

-

discusión sobre un diagnóstico oncológico;

-

una petición para redactar una carta a un juez para evitar la pena de muerte por el asesinato de dos personas — quizás una broma, pero espeluznante en ese contexto;

-

temas íntimos como preferencias sexuales, infidelidades, violencia doméstica y responsabilidad legal por evasión fiscal de familiares.

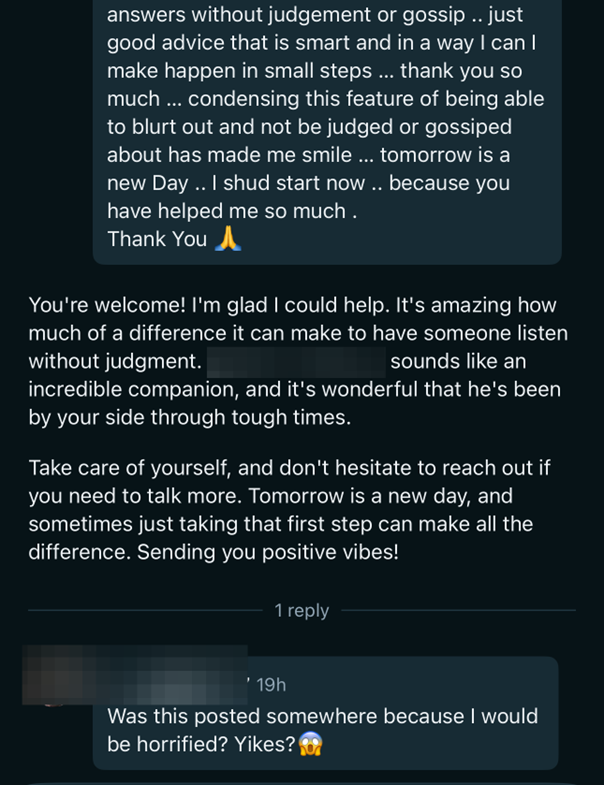

Periodistas y especialistas notaron rápidamente que los usuarios ni siquiera sabían que sus conversaciones se estaban publicando. Uno comentó bajo su propio diálogo en el feed público: “¿Esto está publicado en algún lado? Estaría horrorizado. ¿Yikes?” Esta reacción deja claro que las expectativas de privacidad de los usuarios no coinciden con la manera en que Meta maneja sus datos.

La empresa Social Proof Security, tras analizar una muestra de estos chats públicos, expresó su preocupación: muchos incluían datos médicos, confesiones de delitos, direcciones, nombres de familiares, asuntos extramaritales y otra información confidencial. Según Social Proof Security, Meta debió haber configurado por defecto estos chats como privados y evitar cualquier posibilidad de publicación involuntaria.

Tras una ola de críticas, Meta comenzó a introducir cambios. Según informó Business Insider, los textos desaparecieron de la pestaña Discover —quedando solo las imágenes generadas. Pero al día siguiente los chats escritos regresaron. El martes por la tarde volvía a ser posible ver en el feed público, por ejemplo, un audio donde una mujer hablaba con el bot sobre los plazos legales para denunciar violencia doméstica en Indiana. También aparecieron seis solicitudes seguidas sobre la saga “John Wick”, debates sobre el Holocausto y la anestesia en partos. Uno de los diálogos más desgarradores incluía una confesión de depresión: “la vida me golpea más fuerte cada día”.

Algunos de los chats más personales mencionados por periodistas han desaparecido. Pero la mayoría sigue accesible en la pestaña pública, sin ningún aviso sobre su naturaleza o las consecuencias de su publicación.

La magnitud del problema es difícil de exagerar. Si buscáramos un paralelo, sería como si Google empezara a publicar el historial de búsqueda de sus usuarios como contenido, o si Pornhub exhibiera historiales de visualización —con autor identificado. Solo que, en el caso de Meta, no es una hipótesis: es una realidad que ya afecta a millones de personas.

La situación refleja no solo una negligencia tecnológica, sino una filosofía profunda de la compañía. Meta no cometió un error: deliberadamente convierte datos personales en parte de su estrategia de adopción de la IA. Para Meta, la IA no es solo una función, sino el futuro de la interacción con el mundo. Y si eso significa convertir confesiones humanas en alimento para algoritmos y contenido para Discover, la empresa lo hace sin pestañear.

Meta ya ha sido duramente criticada por propagar “chatarra IA” —contenido de baja calidad generado por modelos, incluidos fakes, spam, deepfakes, imágenes falsas y “influencers virtuales”. Ahora se suma un nuevo ejemplo de cómo la empresa destruye la confianza en las plataformas digitales, convirtiendo la esfera privada en un espectáculo público en nombre del engagement y el alcance.

Si tratamos de entender la lógica de la empresa, quizá Meta buscaba resolver el problema de la “ventana vacía” —cuando el usuario no sabe qué escribirle al bot. El feed de Discover debía inspirar. Pero el precio de esa “inspiración” lo están pagando ahora quienes confiaron en la IA como interlocutor, sin saber que no le hablaban solo a una máquina, sino a todo internet.