Subiste una foto para hacerte un nuevo avatar, y ahora alguien está entrenando ChatGPT con tu cara

Te has convertido al mismo tiempo en un personaje de Ghibli, un objeto de análisis y la futura imagen de alguna publicidad.

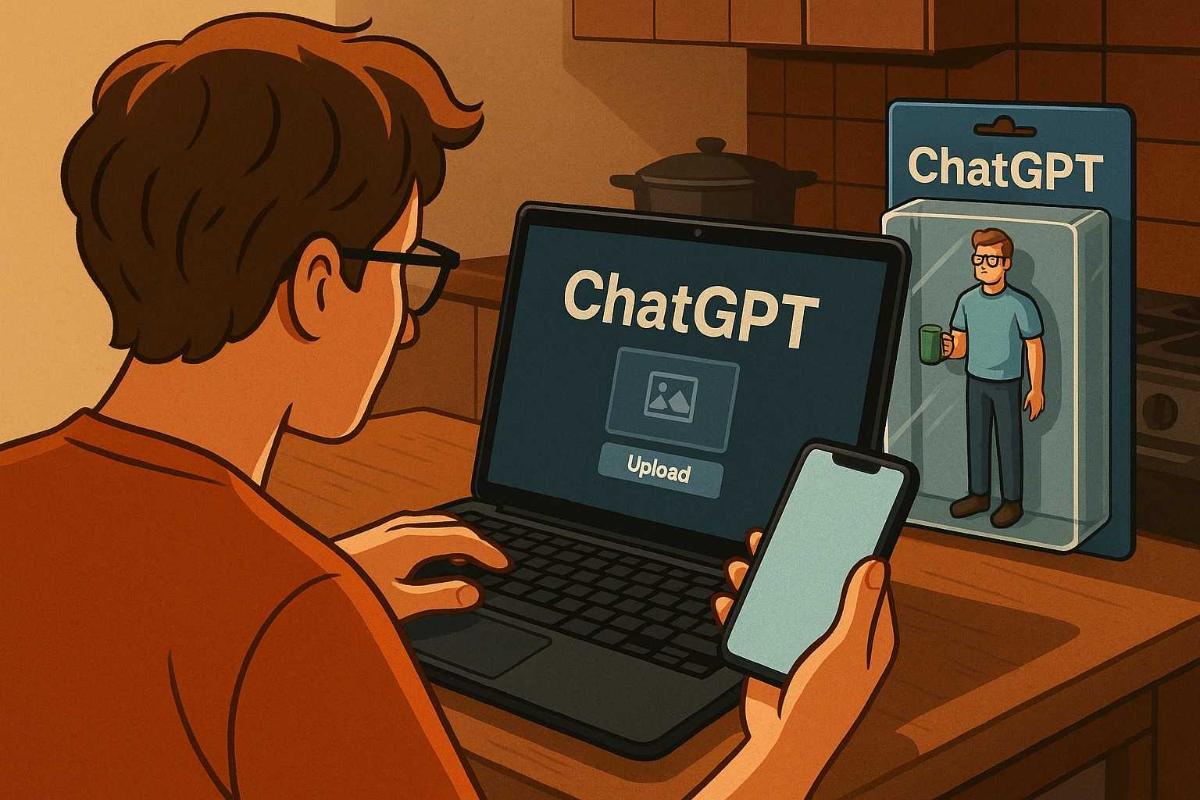

Desde principios de abril, las redes sociales LinkedIn y X se han llenado de imágenes de usuarios convertidos en figuras en miniatura. Cada personaje tiene sus propios accesorios: desde una esterilla de yoga hasta auriculares. Miles de personas participan en esta tendencia, generando estas imágenes con el nuevo generador de imágenes de ChatGPT basado en GPT-4o. Esta herramienta no solo dibuja al estilo de Studio Ghibli, sino que también convierte una foto en un avatar detallado tipo muñeco. Sin embargo, detrás de este juego aparentemente inocente se esconde un intercambio poco evidente: contenido visual a cambio de datos personales.

Para crear una figurita, basta con subir una foto. Pero con ella no solo se carga el rostro, sino también muchos otros datos —desde metadatos EXIF hasta el contenido del fondo. En el archivo de imagen puede conservarse información sobre la hora de captura y la geolocalización, y si la foto es de alta resolución, OpenAI también recibe objetos del fondo, otras personas, e incluso elementos legibles como credenciales. Así lo subraya Tom Vasdar, del Open Institute of Technology, quien señala que estos datos proporcionados voluntariamente son el material ideal para entrenar redes neuronales, especialmente las multimodales.

Además de las fotos, ChatGPT también registra parámetros del dispositivo: tipo, sistema operativo, navegador, identificadores únicos, así como el comportamiento del usuario: con qué prompts trabaja, cómo interactúa con la interfaz, qué edita. Los expertos destacan que no se trata solo de biometría, sino del contexto: el contenido de la habitación, la ropa, los objetos sobre la mesa. Todo esto genera un enorme volumen de información personalizada.

Aunque OpenAI niega que el lanzamiento de la tendencia de las figuritas fuera un paso deliberado para recolectar datos, la empresa sí obtiene un beneficio importante: los usuarios cargan voluntariamente rostros frescos y variados —de distintos continentes, edades y grupos étnicos. En un contexto donde a las empresas les resulta cada vez más difícil recolectar datos de forma abierta, estas campañas funcionan mejor que cualquier embudo de conversión.

Según la política de privacidad vigente de OpenAI, las imágenes enviadas a través de ChatGPT pueden ser utilizadas para mejorar los modelos. Y aunque la empresa afirma que no crea perfiles publicitarios ni vende información personal, sí se reserva el derecho a procesar el contenido. A su vez, OpenAI asegura priorizar la privacidad, y declara que sus modelos se entrenan con datos del mundo y no de personas específicas. Los usuarios disponen de herramientas de control, incluyendo exportación, eliminación y la opción de impedir el uso de sus datos para entrenamiento.

En Europa y el Reino Unido rigen normas estrictas, incluido el GDPR, que exige un consentimiento específico para procesar datos biométricos. Pero como señala la abogada Melissa Hall, una imagen solo se considera biométrica si se procesa con el objetivo de identificar de forma única. Convertir una foto en una versión caricaturesca difícilmente encaja en esa definición. En EE.UU., en cambio, la regulación es inconsistente: California e Illinois aplican medidas más estrictas, pero no existe una política unificada, lo que crea un vacío legal.

Los abogados advierten que, en ausencia de restricciones claras, un rostro cargado una vez puede permanecer en el sistema para siempre —convertirse en parte de modelos futuros o vincularse con otros datos. Incluso si la plataforma promete no usar la imagen directamente, los mecanismos de eliminación y control aún son demasiado ambiguos.

Los expertos recomiendan activar en la configuración de ChatGPT la opción para impedir el uso de datos en el entrenamiento, desactivar el historial de chats, y eliminar previamente los metadatos de las imágenes. Es preferible usar filtros, fotos distorsionadas o avatares digitales. También se debe prestar atención al fondo —puede revelar más de lo que parece. Y lo más importante: no subir fotos de otras personas sin su consentimiento; el usuario es responsable del contenido.

La tendencia de las figuritas Ghibli y otras transformaciones generadas por IA no desaparecerá pronto. Pero antes de compartir tu nuevo avatar en redes sociales, vale la pena pensar dos veces qué es lo que terminará al otro lado del generador.